Угроза искусственного интеллекта пришла оттуда, откуда никто не ждал. GPT-4 внезапно отупел, хотя и только на некоторых типах запросов. Этот прецедент показывает риски, возникающие при высокой зависимости от помощи ИИ, а также указывает новые возможности для злоупотреблений. Ко всему этому нужно быть готовыми.

Весной было много сообщений, как ИИ с легкостью проходит университетские экзамены. Программисты уже наловчились писать с его помощью куски кода. Однако в начале лета обнаружилось, что на некоторых задачах качество ответов искусственного интеллекта резко просело.

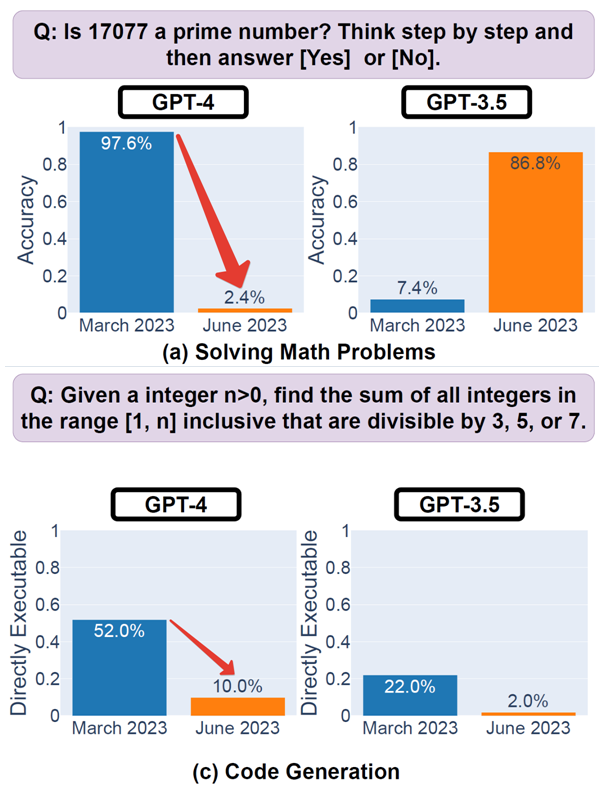

Первые жалобы появились еще в начале июня на профессиональных форумах. Через месяц их заметила пресса. А 18 июля на сервере препринтов была выложена статья с измерениями сравнительных показателей качества ответов GPT-4 в марте и в июне. На некоторых задачах доля правильных ответов упала с 97,6% до 2,4%. Наконец, в четверг 20 июля компания-разработчик (OpenAI) признала в своем чате, что такое действительно имеет место в последней версии GPT-4, хотя только на некоторых задачах, а на остальных показатели растут.

Тут надо, однако, учитывать, что, хотя мощные нейросети и являются пока передовой экспериментальной технологией, доступ ко многим из них уже активно продается в качестве коммерческого продукта. В частности, ChatGPT-4 стоит $20 в месяц. Это значит, что многие клиенты будут полагаться на возможность оптимизировать свои рабочие процессы с использованием нейросетей. То есть нейросетям фактически делегируется часть операций по созданию компаниями их собственных продуктов: помощь ИИ учитывается при оценке трудозатрат и стоимости производства.

Если же качество работы ИИ подвержено непредсказуемым многократным просадкам, то планировать любой бизнес с его использованием становится крайне рискованно. Фактически оказывается, что часть компетенций компаний передается на аутсорсинг искусственному интеллекту на основе одного лишь прежнего опыта взаимодействия, безо всяких гарантий соответствия каким-либо требованиям.

Нельзя сказать, что эта ситуация абсолютно беспрецедентная. Довольно часто оказывается, что новая версия знакомого программного обеспечения лишается каких-то важных функций, которые поддерживались в старых версиях. Например, при переходе от Windows 7 к Windows 8 из интерфейса пропала кнопка «Пуск», к которой все привыкли. Это снизило производительность работы, и ее потом вернули. А в Windows 11 нельзя отказаться от объединения кнопок в панели задач и опять многие работы замедлились. Однако обновление ПО, установленного на компьютерах пользователей — это хотя бы отчасти контролируемый процесс.

В случае серверного ПО зависимость от произвола разработчиков значительно возрастает. Особенно серьезные проблемы испытывают программисты. От них могут неожиданно закрыть доступ к привычным программным интерфейсам (API) или потребовать перехода на новые стандарты. Но, по крайней мере, у этих процессов обычно есть четкие даты и спецификации, а затрагивают они лишь немногих, кто к этому готовы.

Нейросетевые сервисы нацелены на гораздо более широкую аудиторию и меняются при этом почти непрерывно и непредсказуемо. Даже их разработчики не могут заранее сказать, качество решения каких задач просядет при очередном обновлении или дообучении ИИ.

А еще на горизонте маячит довольно опасная возможность контролировать успех бизнесов, которые полагаются на работу нейросетевых сервисов, через компании, которые эти сервисы предоставляют. Нечто подобное имеет место сейчас в случае поисковых сервисов и соцсетей. Они могут без предупреждения пессимизировать одни источники информации и усиливать продвижение других.

Поисковики, например, с давних времен объясняют это борьбой с поисковым спамом в интересах большинства пользователей. То есть поисковые машины по собственным и в общем случае непубличным критериям определяют, какие сайты искусственно манипулируют поисковой выдачей и понижают их видимость, а то и вовсе исключают из индекса. Владелец сайта должен быть готов к тому, что однажды утром его информационная площадка, в продвижение которой он вложился, вдруг перестанет обнаруживаться большинством потенциальных клиентов.

Нечто подобное происходит и в социальных сетях, где в последние годы отмечается значительное усиление цензуры. Опять же, это оправдывается интересами пользователей: борьбой с дезинформацией, неприемлемым контентом, языком вражды. Однако после приобретения Твиттера Илон Маск передал журналистам ряд внутренних материалов компании, демонстрирующих целенаправленное вмешательство в распространение информации в соцсети под политическим давлением. Скандал вокруг «файлов Твиттера» еще раз показал, что цензура всегда создает почву для политических злоупотреблений.

Тут важно отметить, что алгоритмы пессимизации в поисковиках и выявление нежелательного контента в соцсетях стали использовать элементы искусственного интеллекта значительно раньше массового бума нейросетей. Опытные пользователи уже успели приспособиться к ошибкам роботов-цензоров, например, к их непониманию юмора и контекста и стали писать так, чтобы обходить цензуру. И все же, в случае поисковиков и соцсетях можно говорить о целенаправленном вмешательстве и хотя бы о теоретической возможности контроля над злоупотреблениями. В случае же многообразных нейросетевых сервисов любые неожиданные вариации надежности и содержания генерируемого контента можно списать на непредсказуемые (в самом деле) особенности обучения. Общественный контроль над цензурой становится еще более сложным.

Чтобы нейросетевые сервисы стало возможно использовать не в качестве эпизодического подспорья для малого бизнеса, а существенно шире в качестве критических элементов бизнеса более серьезного, важно предусматривать меры безопасности, защищающие от таких эффектов.

Для начала, если вы сильно зависите от участия ИИ в решении важных задач, желательно использовать для этого нескольких независимых сервисов, которые в основных функциях заменяют друг друга. И, более того, надо постоянно практиковать применение всех этих сервисов, чтобы не пропадал эффект включенности. Иначе в момент возникновения проблем с одним сервисом вы можете быть неприятно удивлены, что резервный сервис давно не соответствует вашим потребностям. Крупным организациям вообще стоит подумать о запуске нейросетей на собственных вычислительных мощностях. Это сделает их в известной мене независимыми от обновлений.

А еще работа публичных нейросетевых сервисов должна постоянно подвергаться независимому мониторингу, чтобы общество своевременно узнало, если они станут использоваться для манипулирования или просто потеряют какие-то способности, которыми обладали ранее. Упомянутый в начале статьи препринт — это как раз прообраз необходимых в будущем систем мониторинга сервисов на базе ИИ.

И, наконец, провайдерам нейросервисов надо ответственно подходить к обновлению своих продуктов, учитывая, что по самой природе нейросетей их обновление сопряжено с непредсказуемыми вариациями качества работы. В частности, компания OpenAI сообщила в своем блоге, что возможность доступа старым версиям GPT-3.5 и GPT-4, которую предполагалось прекратить 13 сентября, теперь будет продлена как минимум на 9 месяцев — до 13 июня 2024 года.

Напоследок заглянем немного в будущее, когда использование функций ИИ становится неотъемлемой частью интеллектуальной жизни. Можно предположить, что к тому времени это уже будет не только компьютерный сервис, как сейчас интернет с поисковиками, но инструмент, значительно усиливающий когнитивные функции человека. И тогда неожиданный отказ в работе таких систем может напрямую влиять на личностные характеристики людей, вызывая проблемы, чем-то подобные амнезии или деменции. Образ такой когнитивной аварии мы с нейросетью Midjourney сделали иллюстрацией к этому материалу и соответствующему ролику на YouTube.

Текст: АЛЕКСАНДР СЕРГЕЕВ

Александр Сергеев 2.08.2023